NộI Dung

Nguồn: Lin Shao Hua / Dreamstime.com

Lấy đi:

Sự tiến bộ của AI là không thể tránh khỏi, và những gì chuyển thành nhân loại không hoàn toàn rõ ràng. Một số người tin rằng chúng ta có thể mong đợi một tương lai tuyệt vời, trong khi những người khác nghĩ rằng điều đó có nghĩa là chúng ta đang trên con đường được thay thế bởi các lớp phủ robot. Quan điểm thứ ba là nhận thức về rủi ro nhưng coi chúng là có thể quản lý được.

Chúng tôi nghe rất nhiều về AI và tiềm năng biến đổi của nó. Điều đó có nghĩa gì cho tương lai của nhân loại, tuy nhiên, không hoàn toàn rõ ràng. Một số nhà tương lai tin rằng cuộc sống sẽ được cải thiện, trong khi những người khác nghĩ rằng nó đang bị đe dọa nghiêm trọng. Có một loạt các vị trí ở giữa. Ở đây, một loạt các mất từ 11 chuyên gia.

1. Cho đến nay, mối nguy hiểm lớn nhất của Trí tuệ nhân tạo là mọi người kết luận quá sớm rằng họ hiểu nó. - Eliezer Yudkowsky

Đó là câu đầu tiên trong báo cáo của Yudkowsyiến 2002 với tựa đề Trí tuệ nhân tạo là một nhân tố tích cực và tiêu cực trong rủi ro toàn cầu đối với Viện nghiên cứu trí thông minh máy móc (MIRI). Mặc dù thuật ngữ AI đã được băng bó gần như bây giờ, nhưng vẫn còn một vấn đề thiếu hiểu biết về khả năng và giới hạn của công nghệ. Trên thực tế, trong vài năm qua, đã có nhiều nỗ lực để khiến AI không chỉ dễ hiểu mà còn có thể giải thích được.

2. Điều quan trọng là làm cho mọi thứ về AI có thể giải thích được, công bằng, an toàn và theo dòng dõi, có nghĩa là bất cứ ai cũng có thể thấy rất đơn giản xem bất kỳ ứng dụng nào của AI đã phát triển và tại sao. - Ginni Rometty

Giám đốc điều hành của IBM đã đưa ra tuyên bố đó trong bài phát biểu chính của mình tại CES vào ngày 9 tháng 1 năm 2019. Bối cảnh của việc khẳng định nhu cầu về AI có thể giải thích là việc giữ nó như một hộp đen kín khiến không thể kiểm tra và khắc phục các sai lệch hoặc các vấn đề khác trong lập trình. IBM đã đặt mình vào nỗ lực giải quyết vấn đề này, không chỉ cung cấp dịch vụ điện toán cho các công ty, mà còn tư vấn về việc giảm sự thiên vị cho những người đang xây dựng các hệ thống máy học. (Tìm hiểu thêm về AI có thể giải thích trong AI Hàng Có một số giải thích để làm.)

Không lỗi, không căng thẳng - Hướng dẫn từng bước của bạn để tạo ra phần mềm thay đổi cuộc sống mà không phá hủy cuộc sống của bạn

Bạn không thể cải thiện kỹ năng lập trình của mình khi không ai quan tâm đến chất lượng phần mềm.

3. "Cuối cùng máy tìm kiếm, điều này sẽ hiểu, bạn biết, chính xác những gì bạn muốn khi bạn nhập một truy vấn và nó sẽ cung cấp cho bạn điều chính xác trở lại, trong khoa học máy tính chúng tôi gọi đó là trí tuệ nhân tạo. Điều đó có nghĩa là nó sẽ thông minh, và chúng tôi rất lâu mới có máy tính thông minh. - Trang Larry

Đồng sáng lập và Giám đốc điều hành của Google tại thời điểm đó đã nói điều này vào tháng 11 năm 2002 trong một phân đoạn của PBS NewsHour có tên là Google Google: Công cụ tìm kiếm có thể. Chủ nhà đã mở ra một phản ánh về sự phổ biến ngày càng tăng của Google trong năm Phương ngữ Mỹ Xã hội xếp nó là động từ hữu ích nhất được thêm vào sử dụng, mặc dù phải mất thêm vài năm nữa để nó được công nhận bởi những người như Merriam-Webster. Nhưng ngay từ đầu, công ty đã báo hiệu sự quan tâm của mình trong việc sử dụng AI.

4. Tránh tránh ở TẤT CẢ CÁC CHI PHÍ bất kỳ đề cập hoặc ngụ ý về AI. Weaponized AI có lẽ là một trong những chủ đề nhạy cảm nhất của AI - nếu không phải là nhất. Đây là thịt đỏ cho các phương tiện truyền thông để tìm mọi cách để làm hỏng Google. - Fei Fei Li, người tiên phong về AI tại Google, nói với các đồng nghiệp về sự tham gia của công ty trong dự án Maven

Google thấy rằng trở thành một người chơi chính trong AI có thể có một nhược điểm. Vào tháng 7 năm 2017, Bộ Quốc phòng đã trình bày các mục tiêu của mình cho Dự án Maven. Đại tá thủy quân lục chiến Drew Cukor, trưởng nhóm chức năng chéo chiến tranh thuật toán trong Ban chỉ huy hoạt động tình báo, giám sát và trinh sát - Văn phòng hỗ trợ chiến binh trong văn phòng của quân đội dưới quyền các máy tính sẽ hoạt động cộng sinh để tăng khả năng phát hiện các vật thể của vũ khí.

Google đã từng là một đối tác trong liên doanh này, nhưng - như được chỉ ra bởi trích dẫn ở trên - nhân viên của Google đã không thích nó. Cuối cùng, công ty đã chịu khuất phục trước áp lực và vào tháng 6 năm 2018 tuyên bố sẽ không gia hạn hợp đồng với Bộ Quốc phòng. Như The Intercept đã báo cáo:

Google phải đối mặt với áp lực ngày càng tăng kể từ khi hợp đồng được tiết lộ bởi Gizmodo và The Intercept vào tháng 3. Gần một chục nhân viên đã từ chức để phản đối, và vài ngàn người đã ký một bức thư ngỏ tuyên bố rằng Google không nên tham gia vào chiến tranh. Hơn 700 học giả cũng đã ký một lá thư yêu cầu Google chấm dứt hợp đồng với DoD, và rằng Google và công ty mẹ của nó, Alphabet cam kết không phát triển các công nghệ quân sự và không sử dụng dữ liệu cá nhân mà họ thu thập cho mục đích quân sự.

5. Trí thông minh nhân tạo sẽ đạt đến cấp độ con người vào khoảng năm 2029. Tiếp theo đó, đến năm 2045, chúng ta sẽ nhân rộng trí thông minh, trí thông minh máy sinh học của con người trong nền văn minh của chúng ta lên gấp hàng tỷ lần. - Ray Kurzweil

Nhà tương lai và nhà phát minh đã nói điều này trong một cuộc phỏng vấn năm 2012, trong đó ông nói về việc đạt được sự bất tử thông qua sức mạnh tính toán. Ông đã xác nhận con số của tỷ tỷ gấp nhiều lần và giải thích nó như sau: Rằng Rằng mà một sự thay đổi kỳ lạ đến mức chúng ta mượn phép ẩn dụ này từ vật lý và gọi đó là một điểm kỳ dị, một sự thay đổi sâu sắc trong lịch sử loài người. Suy nghĩ của chúng ta sẽ trở thành sự lai tạp giữa tư duy sinh học và phi sinh học. Rõ ràng, anh ta là một trong những người tương lai lạc quan, hình dung một sự thay đổi đột phá sẽ mang lại lợi ích lớn. Anh ấy giải thích thêm lý do tại sao anh ấy tin rằng sự bất tử là trong tầm tay: chúng tôi sẽ thêm hơn một năm mỗi năm vào tuổi thọ còn lại của bạn, nơi mà thời gian đang trôi qua thay vì hết, nơi tuổi thọ còn lại của bạn thực sự kéo dài như Thời gian trôi qua."

6. Những lợi ích lớn nhất của sự xuất hiện của trí tuệ nhân tạo là AI sẽ giúp định nghĩa loài người. Chúng ta cần AI để cho chúng ta biết chúng ta là ai. - Kevin Kelly

Người đồng sáng lập Wired đã viết lời khẳng định sâu rộng này trong cuốn sách năm 2016 của anh ấy, không thể tránh khỏi: Hiểu về 12 lực lượng công nghệ sẽ định hình tương lai của chúng tôi. Khi anh ấy hình dung sự gia tăng của tự động hóa và công việc bị robot chiếm lĩnh, anh ấy dự đoán rằng ở đó sẽ là một chu kỳ từ chối lặp đi lặp lại, nhưng sự tiến bộ là không thể tránh khỏi, và chúng ta sẽ phải điều chỉnh cho phù hợp. Như anh ấy đã giải thích trong một cuộc phỏng vấn với IBM: qua Through AI, chúng tôi sẽ phát minh ra nhiều kiểu suy nghĩ mới không tồn tại về mặt sinh học và không giống như suy nghĩ của con người, đó là lớp lót bạc cho đám mây máy tính mà anh ấy nhấn mạnh là thế này: vì vậy, trí thông minh này không thay thế suy nghĩ của con người, mà làm tăng thêm nó.

7. Nguy cơ thực sự với AI là ác ý nhưng năng lực. Một AI siêu thông minh sẽ cực kỳ giỏi trong việc hoàn thành các mục tiêu của mình và nếu những mục tiêu đó không phù hợp với chúng tôi, chúng tôi sẽ gặp rắc rối. Bạn có thể không phải là một con kiến độc ác bước ra khỏi con kiến, nhưng nếu bạn có trách nhiệm trong một dự án năng lượng xanh thủy điện và có một con kiến trong khu vực bị ngập lụt, quá tệ cho loài kiến. Hãy để không đặt nhân loại vào vị trí của những con kiến đó. - Stephen Hawking

Câu trích dẫn này có từ đầu năm 2015. Đó là câu trả lời mà Stephen Hawking đưa ra trong buổi hỏi đáp của Reddit AMA (Hỏi tôi bất cứ điều gì) cho một câu hỏi từ một giáo viên muốn biết cách giải quyết một số vấn đề AI xuất hiện trong các lớp học của mình, cụ thể là tiếp theo:

Làm thế nào bạn đại diện cho niềm tin của riêng bạn cho lớp học của tôi? Là quan điểm của chúng tôi hòa giải? Bạn có nghĩ rằng thói quen của tôi về việc giảm giá cho kẻ độc ác kiểu Kẻ giết người theo phong cách Terminator là AI ngây thơ không? Và cuối cùng, bạn nghĩ tôi nên củng cố đạo đức nào cho học sinh của mình quan tâm đến AI?

Hawking cho thấy một số lo ngại về những tác động có thể hủy diệt của AI đối với nhân loại, mặc dù ông dường như tin rằng rủi ro có thể được quản lý nếu chúng ta lập kế hoạch cho nó, một quan điểm được chia sẻ bởi một số người khác. (Để biết thêm về điều này, hãy xem Tại sao AI siêu thông minh sẽ không hủy diệt con người bất cứ lúc nào sớm.)

8. Bạn muốn biết làm thế nào siêu thông minh người máy có thể đối xử với người bình thường bằng xương bằng thịt? Bắt đầu tốt hơn bằng cách điều tra cách con người đối xử với anh em họ động vật kém thông minh của họ. Nó không phải là một sự tương tự hoàn hảo, tất nhiên, nhưng nó là nguyên mẫu tốt nhất mà chúng ta thực sự có thể quan sát thay vì chỉ tưởng tượng. - Yuval Noah Harari

Giáo sư Harari đã đưa ra tuyên bố đó trong cuốn sách năm 2017 của ông, Hom Homo Deus: Lược sử về ngày mai. Quan điểm của ông là cực đoan so với các nhà tương lai học tích cực trong việc hình dung sự trỗi dậy của cái mà ông gọi là chủ nghĩa dữ liệu mà con người từ bỏ nền tảng vượt trội để tiến lên trí tuệ nhân tạo. Chúng tôi bị ràng buộc cho vị trí của những con kiến bị ngập trong lời giải thích của Hawking. Đây là một tương lai bị chi phối bởi một hệ thống xử lý dữ liệu vũ trụ toàn diện và toàn diện, có thể là vô ích.

9. Chúng ta phải giải quyết, các vấn đề cá nhân và tập thể, đạo đức và đạo đức được nêu lên bằng nghiên cứu tiên tiến về trí tuệ nhân tạo và công nghệ sinh học, sẽ cho phép kéo dài cuộc sống đáng kể, em bé thiết kế và khai thác bộ nhớ. - Klaus Schwab

Schwab đã công bố những suy nghĩ của mình về cuộc cách mạng công nghiệp lần thứ tư vào tháng 1 năm 2016. Giống như những người theo chủ nghĩa tương lai tích cực, ông đã hình dung rằng tương lai sẽ hợp nhất thế giới vật lý, kỹ thuật số và sinh học theo những cách mà sẽ biến đổi căn bản loài người. rằng một sự chuyển đổi như vậy là tích cực,, thúc giục mọi người lên kế hoạch trước với nhận thức về cả những rủi ro và cơ hội phát sinh trên đường đi.

10. Phần lớn đã được viết về AI tiềm năng để phản ánh cả những điều tốt nhất và tồi tệ nhất của nhân loại. Chẳng hạn, chúng ta đã thấy AI cung cấp cuộc trò chuyện và sự thoải mái cho người cô đơn; chúng ta cũng đã thấy AI tham gia vào phân biệt chủng tộc. Tuy nhiên, tác hại lớn nhất mà AI có thể gây ra cho các cá nhân trong ngắn hạn là sự dịch chuyển công việc, vì khối lượng công việc chúng ta có thể tự động hóa với AI lớn hơn rất nhiều so với trước đây. Với tư cách là những người lãnh đạo, tất cả chúng ta đều phải đảm bảo rằng chúng ta đang xây dựng một thế giới mà mỗi cá nhân đều có cơ hội phát triển. - Andrew Ng

Câu nói này xuất phát từ nhóm Những gì trí thông minh nhân tạo có thể và không thể làm ngay bây giờ, bài báo Andrew Ng, người sáng lập nhóm Google Brain, cựu giám đốc Phòng thí nghiệm trí tuệ nhân tạo Stanford, đã viết cho Harvard Business Review năm 2016 khi ông là người dẫn đầu trong nhóm AI của Yahoo. (Năm 2017, ông đã trở thành người sáng lập và giám đốc của Landing AI.) Nó giải thích các khả năng và giới hạn của AI như lúc đó, và vẫn còn liên quan đến ngày nay. Mặc dù Ng không đặt ra một tương lai đen tối thống trị dữ liệu, anh ta đồng ý rằng những người phát triển nó có trách nhiệm áp dụng nó một cách có trách nhiệm với sự hiểu biết đầy đủ về cả hậu quả dự định và không lường trước được.

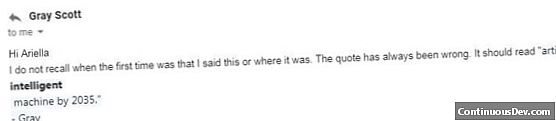

11. Không có lý do và không có cách nào mà một bộ óc con người có thể theo kịp một cỗ máy thông minh nhân tạo vào năm 2035. - Gray Scott

Câu nói này không bị nhầm lẫn, mặc dù nó đi lệch khỏi cách bạn sẽ thấy nó ở bất cứ nơi nào khác trên mạng vì nó luôn xuất hiện dưới dạng Không có lý do và không có cách nào mà trí óc con người có thể theo kịp một cỗ máy trí tuệ nhân tạo vào năm 2035. câu chuyện. Dựa trên mức độ xuất hiện của nó trong các nguồn kỹ thuật số, có thể nó đã được nói vào năm 2015. Tuy nhiên, tôi không thể ghim nó xuống bất kỳ con lừa cụ thể nào ngay cả sau nhiều giờ tìm kiếm thông qua s và video từ thời kỳ đó. Vì vậy, tôi đã liên lạc với Scott để hỏi nguồn. Anh ấy thừa nhận, tôi không nhớ lại lần đầu tiên khi tôi nói điều này hay nó ở đâu. Nhưng anh ấy đã nhớ lại cách diễn đạt của mình: Câu nói luôn luôn sai. Nó nên đọc Intelligent thông minh nhân tạo.